速递|凭语音Demo拿下OpenAI订单,AI语音工具LiveKit融资1亿美元,估值10亿美元

速递|凭语音Demo拿下OpenAI订单,AI语音工具LiveKit融资1亿美元,估值10亿美元提供软件支撑OpenAI 等公司语音、视频及实体 AI 模型的初创企业 LiveKit,在一轮融资中筹集了 1 亿美元,公司估值达 10 亿美元。LiveKit 的软件和网络运行着利用语音、视频以及所谓物理 AI(应用于机器人技术等任务)的人工智能模型。

提供软件支撑OpenAI 等公司语音、视频及实体 AI 模型的初创企业 LiveKit,在一轮融资中筹集了 1 亿美元,公司估值达 10 亿美元。LiveKit 的软件和网络运行着利用语音、视频以及所谓物理 AI(应用于机器人技术等任务)的人工智能模型。

路透社最新消息,Meta 新成立的 AI 团队本月已在内部交付了首批关键模型。据悉,该消息来自 Meta 公司的 CTO Andrew Bosworth,他表示该团队的 AI 模型「非常好」(very good)。

今天,Anthropic 试图向世界展示它的灵魂。Anthropic 正式公布了一份长达 84 页的特殊文档——《Claude 宪法》(Claude's Constitution)。这份文件并非通常意义上的技术白皮书或用户协议,而是一份直接面向 AI 模型本身「撰写」的价值观宣言。

谷歌对其Gemini AI 模型的改进正在提升公司的核心收入。

随着 AI 技术的蓬勃发展, AI 模型的参数规模和推理频次呈指数级增长。据高盛研究部预测,到 2030 年,全球数据中心的电力需求将增长 160%。

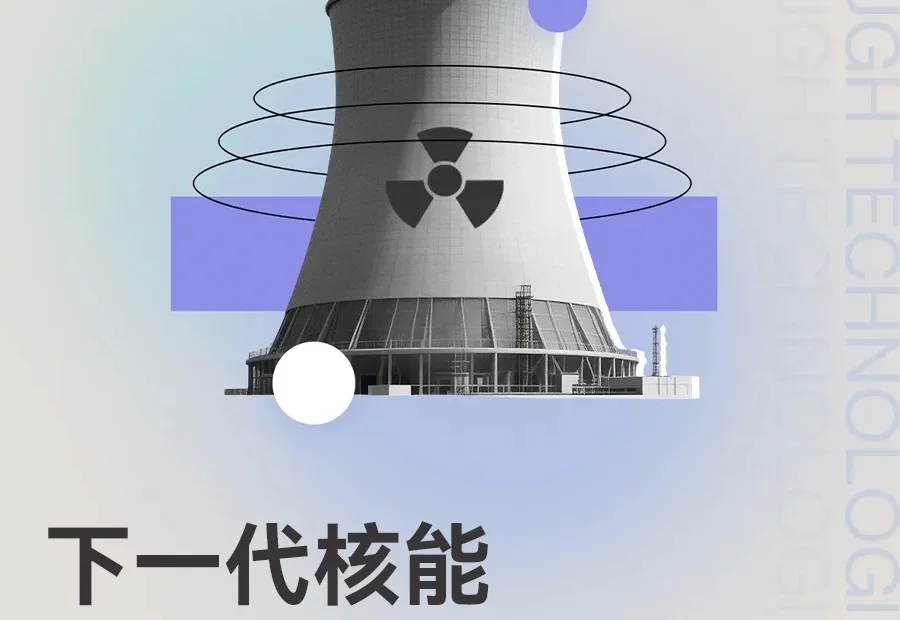

上个月你刚花 20 美元订阅了 ChatGPT Plus,转头这个月朋友圈就被「Claude 秒杀一切」刷屏,再过一个月可能又换成「Gemini 吊打一切」。

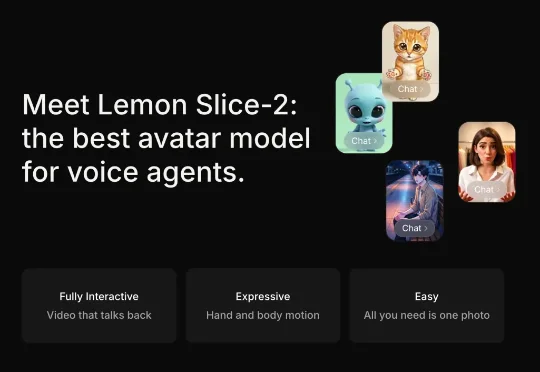

他们开发了一个叫做 Lemon Slice-2 的 AI 模型,可以把任何一张静态图片——无论是公司员工照、卡通角色、还是文艺复兴时期的油画——瞬间变成一个能实时对话的视频头像。

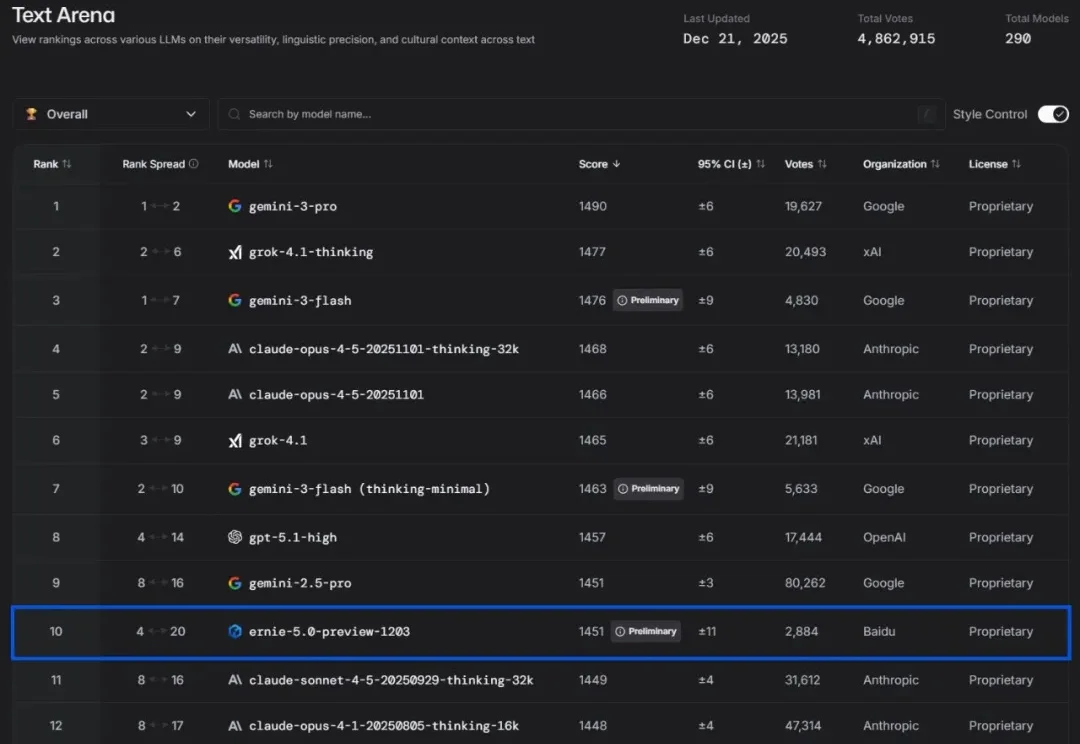

时间过得太快了,一转眼就来到了 2025 年的年底。我们距离 2026 年只剩下了 8 天。回看 AI 模型和产品突飞猛进这一年,中美两家 AI 阵营的行业发展路径有了挺大的区分,大家的关注度不再是单一模型、单一能力,而是“模型+工程+场景”的复合能力。这个变化在年底愈发明显。

最近,在 AI 基础算力上重磅频出的华为,又亮出了一张王牌:昇腾的底层基础软件,CANN 全面开源开放。昇腾宣布将通过一系列新举措,持续支持开发者在 AI 模型、算子、内核、底层资源等多个层级进行自主优化与自定义开发。通过开放共建,一个新兴的 AI 算力生态正在快速崛起,改变计算架构领域本已固化的格局。

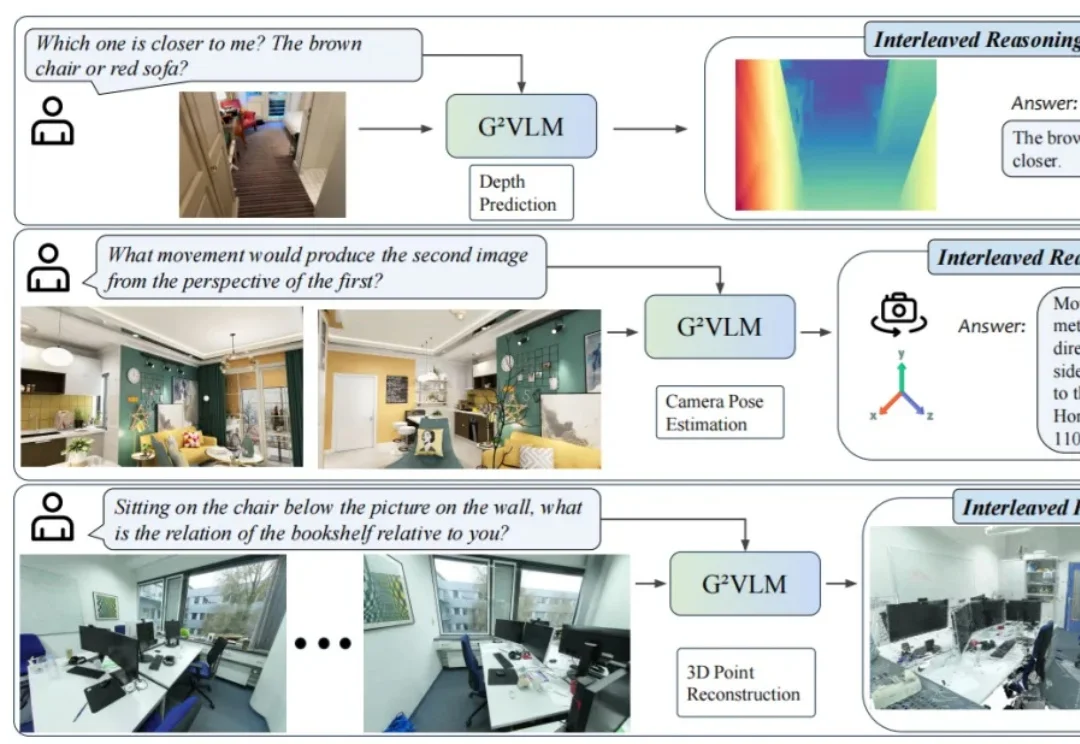

近日,24 岁的 00 后博士生胡文博和所在团队造出一款名为 G²VLM 的超级 AI 模型,它是一位拥有空间超能力的视觉语言小能手,不仅能从普通的平面图片中精准地重建出三维世界,还能像人类一样进行复杂的空间思考和空间推理。